B站发布自研AI配音零样本TTS,IndexTTS2情感可控、时长精准

作者: CBISMB

责任编辑: 宋慧

来源: ISMB

时间: 2025-07-16 15:26

浏览: 1951

点赞: 69

收藏: 54

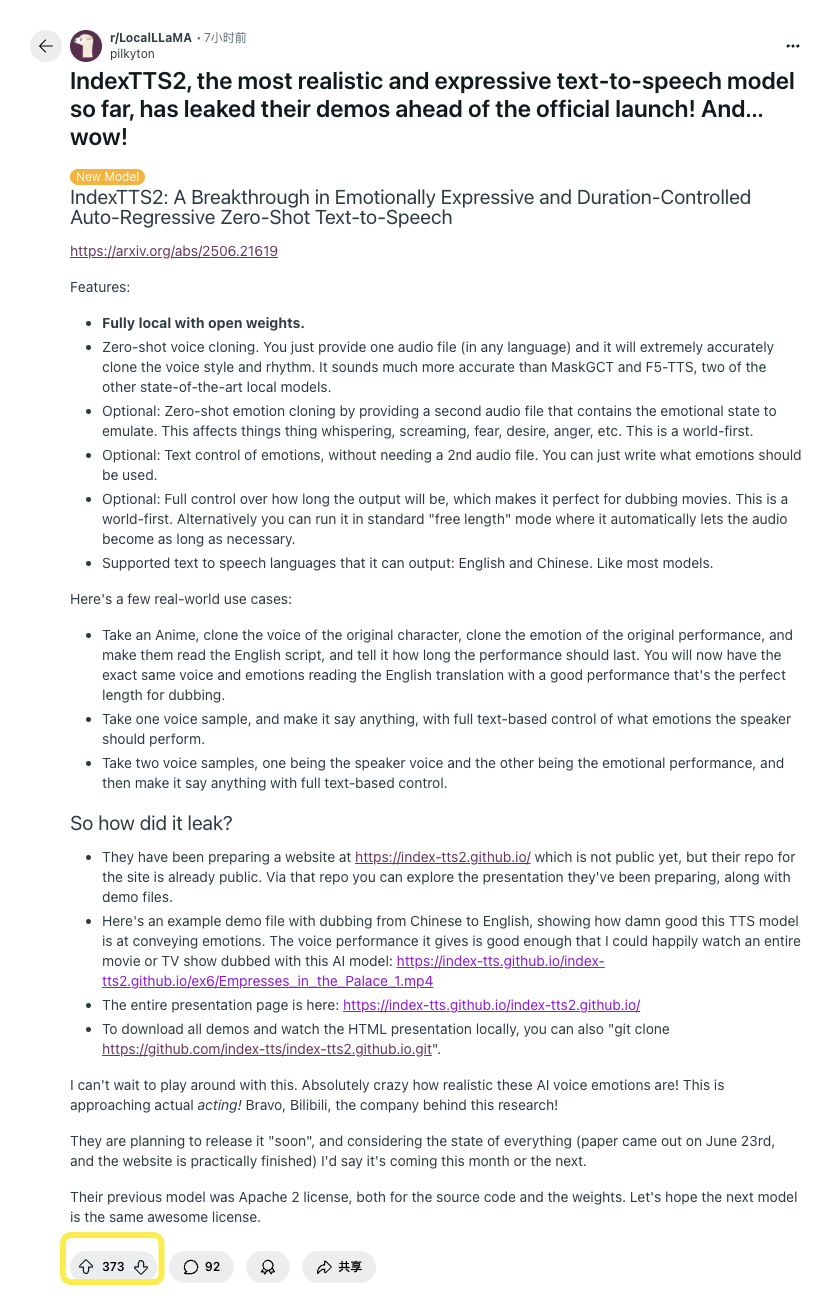

Bilibili 推出了全新升级的IndexTTS2,一种兼顾音质情感与时长控制的 TTS 模型。该系统支持两种生成模式:用户可显式指定语音标记数量以精确控制语音长度,或让模型自由生成自然节奏的语音内容。

在大规模文本转语音(TTS)系统中,自回归模型虽然在语音自然度方面表现出色,但因其逐标记生成的机制,难以实现对语音时长的精准控制。这在如视频配音等需要严格音视频同步的场景中成为一大限制。

IndexTTS2 不仅在时长控制方面实现突破,还实现了情感表达与音色的解耦。它支持从不同来源获取音色提示和情感提示,并在零样本(zero-shot)条件下复现复杂的情绪风格。为提升强情感表达时的语音清晰度,系统还引入了 GPT 模型的潜在表示,从而提升语音的稳定性与可听度。同时,Bilibili 团队设计了基于自然语言的“软指令”机制,借助微调后的 Qwen3 模型,让用户可以直接用文字描述情感(如“温柔地说”)引导语音生成,极大降低了情绪控制的门槛。

配音更“像个人”,IndexTTS2 的核心突破

- 精准时长控制:IndexTTS2 是全球首个在自回归(AR)架构下实现精确语音时长控制的零样本TTS模型。传统自回归模型因逐标记生成机制难以控制时长,而IndexTTS2支持两种模式:用户可显式指定标记数量以精确控制时长,或由模型自由生成自然节奏语音。这对视频配音等需音画同步的场景至关重要 。

- 情感与音色解耦:通过分离音色提示(timbre prompt)和情感提示(style prompt),模型能在零样本条件下复现复杂情绪,且支持从不同来源分别获取两类提示(如用A音频的音色+B音频的情感生成语音)。

- 自然语言情感控制:引入基于Qwen3微调的"软指令"机制,用户可直接用文字描述情感(如"温柔地说"),大幅降低操作门槛 。

- 语音克隆:零样本模式下仅需5秒参考音频即可克隆音色,少样本模式通过1分钟训练进一步提升真实感 。

©本站发布的所有内容,包括但不限于文字、图片、音频、视频、图表、标志、标识、广告、商标、商号、域名、软件、程序等,除特别标明外,均来源于网络或用户投稿,版权归原作者或原出处所有。我们致力于保护原作者版权,若涉及版权问题,请及时联系我们进行处理。