云服务、OEM 借助 NVIDIA AI 让 AI 训练更上层楼

作者: CBISMB

责任编辑: 张金祥

来源: ISMB

时间: 2021-12-03 17:49

关键字: NVIDIA AI

浏览: 0

点赞: 0

收藏: 0

借助NVIDIA AI,戴尔、浪潮、Microsoft Azure和Supermicro在今天发布的新MLPerf基准测试中创下快速训练AI模型的记录。

看看谁刚刚在快速训练AI模型方面创下新速度记录:戴尔科技、浪潮、Supermicro和在MLPerf基准测试中首次亮相的Azure均在使用NVIDIA AI。

NVIDIA宣布的MLPerf训练1.1结果中,NVIDIA平台在所有八个热门工作负载中都创下了记录。

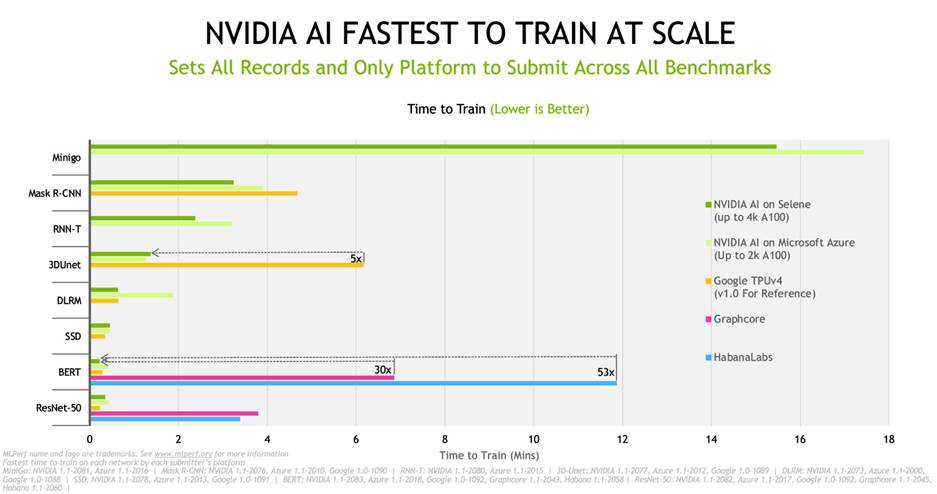

图示:在新一轮的测试中,NVIDIA AI训练所有模型的速度都快于替代方案。

NVIDIA A100 Tensor Core GPU提供了最出色每单芯片性能, Selene是NVIDIA内部基于模块化NVIDIA DGX SuperPOD架构构建的AI超级计算机,借助NVIDIA InfiniBand网络和NVIDIA软件栈进行扩展,A100在Selene上实现了最快的AI训练速度。

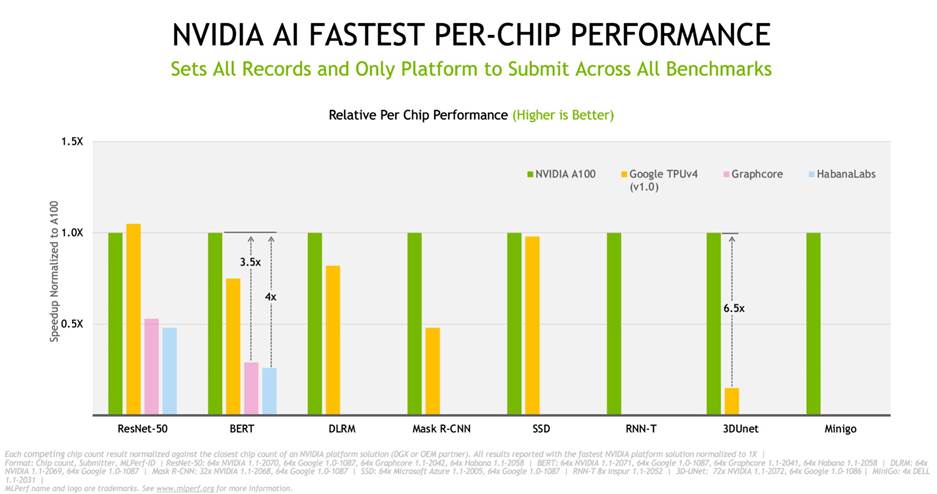

图示:NVIDIA A100 GPU在所有八项MLPerf 1.1测试中均实现最好的每单芯片训练性能。

云服务更上一层楼

根据最新结果,在训练AI模型方面,Azure的NDm A100 v4实例的速度遥遥领先。它运行了新一轮的每项测试,扩展到多达2,048个A100 GPU。

Azure不仅展示了出色性能,而且在美国的六个地区,现在所有人都可以租借和使用其出色性能。

AI训练是一项需要大量投入的大型工作。NVIDIA希望用户借助他们选择的服务或系统以创纪录的速度训练模型。

因此,NVIDIA将NVIDIA AI与面向云服务、主机托管服务、企业和科学计算中心的产品相结合。

服务器制造商各显身手

在OEM中,浪潮凭借其八路GPU服务器NF5688M6和NF5488A5液冷服务器在单节点性能方面创下了最多记录。戴尔和Supermicro在四路A100 GPU系统上创下了记录。

共有10家NVIDIA合作伙伴提交了本轮测试结果,其中包含8家OEM和2家云服务提供商。它们占所有提交的90%以上。

这是NVIDIA生态系统在MLPerf训练测试中的第五次亮相,也是到目前为止最出色的亮相。

NVIDIA的合作伙伴之所以积极参与,是因为他们知道MLPerf是唯一符合行业标准、经过同行评审的AI训练和推理基准测试。对于评估AI平台和供应商的客户来说,这是一个有价值的工具。

为速度认证的服务器

百度PaddlePaddle、戴尔科技、富士通、技嘉科技、慧与、浪潮、联想和Supermicro提交了基于本地数据中心的结果(单节点和多节点任务)。

NVIDIA几乎所有的OEM合作伙伴都在NVIDIA认证系统上运行了测试,NVIDIA为需要加速计算的企业客户验证了服务器。

提交的范围展示了NVIDIA平台的广度和成熟度,该平台为各种规模的企业提供最佳的解决方案。

既快速又灵活

NVIDIA AI是唯一用于提交所有基准测试和用例的平台参与者,这展示了其通用性和高性能。快速灵活的系统提供客户所需的生产力,以加快他们的工作速度。

AI训练基准测试涵盖当今最热门的八个AI工作负载和场景,例如计算机视觉、自然语言处理、推荐系统、增强学习等。

MLPerf测试透明、客观,因此用户可以依靠结果做出明智的购买决策。该行业基准测试组织成立于2018年5月,得到阿里巴巴、ARM、Google、Intel和NVIDIA等数十家行业领先公司的支持。

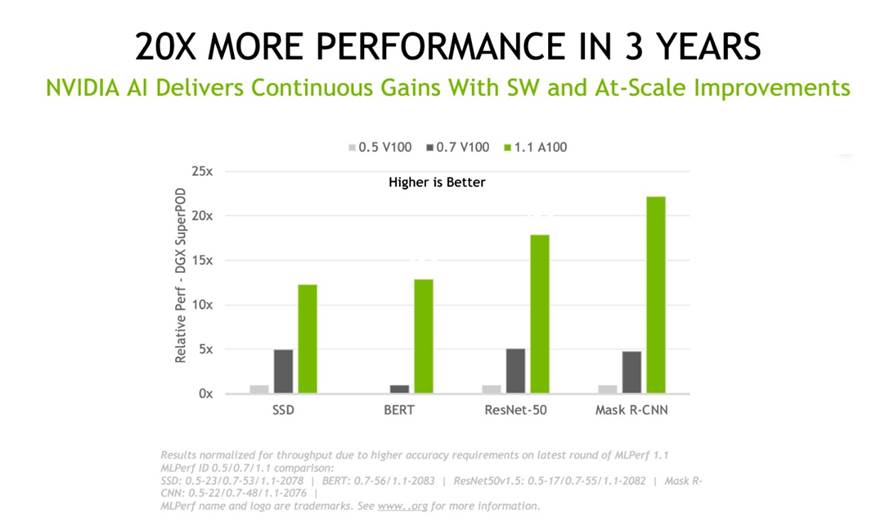

三年内加速20倍

回顾过去,数据显示,仅在过去18个月,NVIDIA A100 GPU的性能就提升了5倍以上。这要归功于软件的持续创新,这也是NVIDIA目前工作的重心。

自从三年前MLPerf测试首次亮相,NVIDIA的性能提高了20倍以上。这种大规模加速源于NVIDIA在全栈GPU、网络、系统和软件方面取得的进步。

图示:NVIDIA AI在三年内实现了20倍以上的改进。

持续改进软件

NVIDIA的新进展来自多项软件改进。

例如,借助一类新的内存复制操作,NVIDIA在针对医学成像的3D-UNet基准测试中实现2.5倍的操作加速。

得益于微调GPU以进行并行处理的方式,NVIDIA在针对物体检测的Mask R-CNN测试中实现10%的速度提升,而在针对推荐系统的测试中实现了27%的提升。NVIDIA只是重叠了独立操作,这种技术尤其适合跨多个GPU运行的作业。

NVIDIA扩展了CUDA图形的使用范围,尽可能减少与主机CPU的通信。得益于此,NVIDIA在针对图像分类的ResNet-50基准测试中实现了6%的性能提升。

NVIDIA在NCCL上实施了两种新技术。NCCL是NVIDIA的库,用于优化GPU之间的通信。对于BERT等大型语言模型,这样可以将结果加速高达5%。

利用NVIDIA工作结果

NVIDIA使用的所有软件均在MLPerf仓库提供,因此每个人都可以获得NVIDIA的出色结果。NVIDIA不断将这些优化整合到NGC(NVIDIA的GPU应用程序软件中心)上的容器。

它是全栈平台的一部分,已在新的行业基准测试中得到验证,可从各种合作伙伴处获得,能够处理当今真正的AI作业。